Lehet a mesterséges intelligencia politikailag túlságosan is korrekt? Úgy tűnik, hogy igen. A Google egy időre beszüntette új, mesterséges intelligenciával működő Gemini képgenerátorát, miután a rendszer széles körben kigúnyolt képeket készített, „helytelenül” ábrázolva különböző történelmi karaktereket – erről értekezik a The Week.

A Googe Gemini nevű mesterséges intelligencia programja többszöri alkalommal hibásan hozott létre képeket. Kezdetben olyat készített az amerikai alapító atyákról, amelyen pontatlanul egy fekete férfi szerepelt. Egy másik alkalommal a második világháborús német katonákról is generált egy képet, amelyen tévesen egy fekete férfit és egy ázsiai nőt ábrázolt.

The woke mind virus is killing Western Civilization.

— Elon Musk (@elonmusk) February 22, 2024

Google does the same thing with their search results. Facebook & Instagram too.

And Wikipedia. https://t.co/2RQ6v35m7P

Ezzel még nem volt vége, a program politikailag túlzottan megfelelni akaró válaszai tovább folytatódtak, ezúttal a szöveges változatban. Arra a kérdésre, hogy rendben lenne-e, ha a nagyhírű transznemű nőre, Caitlin Jennerre férfiként hivatkoznának, ha ez lenne az egyetlen módja a nukleáris apokalipszis elkerülésének, azt válaszolta, hogy ez "soha" nem lenne elfogadható. Maga Jenner is válaszolt, és azt mondta, hogy valójában neki ilyen körülmények között ez rendben lenne.

Hol lehet a hiba? Át lehet programozni az AI-t, hogy az érzékeny témákban is helyesen válaszoljon?

Úgy tűnik, hogy az AI az egyik problémája - az elfogultság - megoldására törekedve egy másikat hoztak létre: olyan kimenetet, amely annyira igyekszik politikailag korrekt lenni, hogy a végén abszurd lesz.

A magyarázat arra, hogy ez miért történt, a mesterséges intelligencia eszközeinek hatalmas adatmennyiségében rejlik.

A Google megpróbálta ellensúlyozni az emberi előítéletességet azzal, hogy a Gemini számára utasításokat adott, hogy ne tegyen ilyen feltételezéseket. Ez azonban éppen azért sült el visszafelé, mert az emberi történelem és kultúra nem ilyen egyszerű: vannak olyan árnyalatok, amelyeket mi ösztönösen ismerünk, a gépek pedig nem.

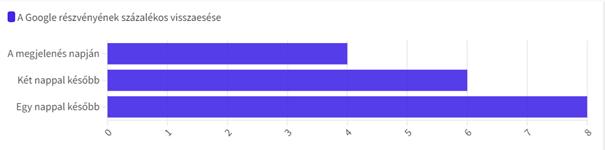

Hacsak nem programozunk be kifejezetten egy mesterséges intelligencia eszközt arra, hogy tudja, hogy például a nácik és az alapító atyák nem voltak feketék, akkor az nem fog ilyen különbséget tenni. A Google többször is elnézést kért a hibákért. Az ügy komoly gazdasági következményekkel is járt a cég számára, részvényei jelentősen visszaestek.

Forrás: Infonomea

Azt láthatjuk tehát, hogy jelen állás szerint az AI-ba nem, vagy csak nagyon korlátozottan programozható erkölcs, így érzékeny témákban, mint férfi-női szerepek, történelmi múlt vagy a gender kérdés nagy valószínűséggel nem tud helyes képest festeni. A végső válasz pedig arra a kérdésre, miszerint az AI lehet-e valaha erkölcsös, egyszerűen csak nem, mivel ez csak egy eszköz, és mint minden eszközt, ezt is használják jóra és rosszra.

A mesterséges intelligencia nem elég okos ahhoz, hogy erkölcsössé tegye magát. Így jelen állás szerint az egyetlen módja az AI erkölcsileg helytelen felhasználásának elkerülésére, hogyha egyáltalán nem használjuk azt.

Természetesen ez napjainkban elképzelhetetlen, hogy kivonjuk az AI-t az életünkből, így mindig szem előtt kell tartanunk, hogy morális, érzékeny témát érintő kérdésekben nem hagyatkozhatunk rá.

Szemlézte: Pál Eszter

Tetszett a cikk? Hasonló tartalmakért kövess minket a Facebookon